Métriques de précision de traduction : Expliquées

Les métriques de précision de traduction aident à évaluer la qualité des traductions automatiques par rapport aux références créées par l'homme. Ces outils sont essentiels pour évaluer la qualité de la traduction, en particulier lors du traitement de projets à grande échelle ou de contenu à enjeux élevés. Les métriques se divisent en trois catégories :

- Métriques basées sur les chaînes : BLEU, METEOR, et TER se concentrent sur le chevauchement des mots ou des caractères.

- Métriques basées sur les réseaux de neurones : COMET et BERTScore analysent la similarité sémantique à l'aide de modèles d'IA.

- Évaluations humaines : Les évaluations directes comme MQM se concentrent sur l'adéquation et la fluidité.

Points clés à retenir :

- BLEU : Rapide et simple mais a du mal avec les synonymes et le sens plus profond.

- METEOR : Tient compte des synonymes et des nuances linguistiques ; mieux pour les œuvres littéraires.

- TER : Mesure l'effort d'édition mais ignore la qualité sémantique.

- COMET & BERTScore : Modèles d'IA avancés qui s'alignent étroitement sur le jugement humain, excellents pour les textes nuancés.

Pour les traductions de livres, la combinaison d'outils automatisés avec des évaluations humaines garantit la précision et préserve le style original. Les plateformes comme BookTranslator.ai utilisent cette approche hybride pour fournir des résultats fiables dans plus de 99 langues.

Métriques courantes de précision de traduction

Score BLEU

Introduit en 2002, BLEU (Bilingual Evaluation Understudy) reste une métrique incontournable pour évaluer la traduction automatique [4]. Il fonctionne en comparant la précision des n-grammes, ce qui signifie analyser comment les séquences de mots dans la sortie de la machine s'alignent avec les traductions de référence. Les scores BLEU vont de 0 à 1, les nombres plus élevés signalant une meilleure qualité. Son plus grand atout ? La vitesse et la simplicité - BLEU peut traiter des milliers de traductions rapidement, ce qui le rend très pratique. Cette efficacité lui a même valu le prix Test-of-Time de la NAACL 2018.

Comme l'ont expliqué Papineni et al., « L'idée principale est d'utiliser une moyenne pondérée des correspondances de n-grammes de longueur variable entre la traduction du système et un ensemble de traductions de référence humaines » [4].

Cependant, BLEU a une limitation notable : il privilégie les correspondances exactes de mots. Cela signifie qu'il pourrait sous-estimer les traductions qui transmettent le même sens mais utilisent une formulation différente. Pour remédier à cela, des métriques comme METEOR visent à capturer les nuances linguistiques.

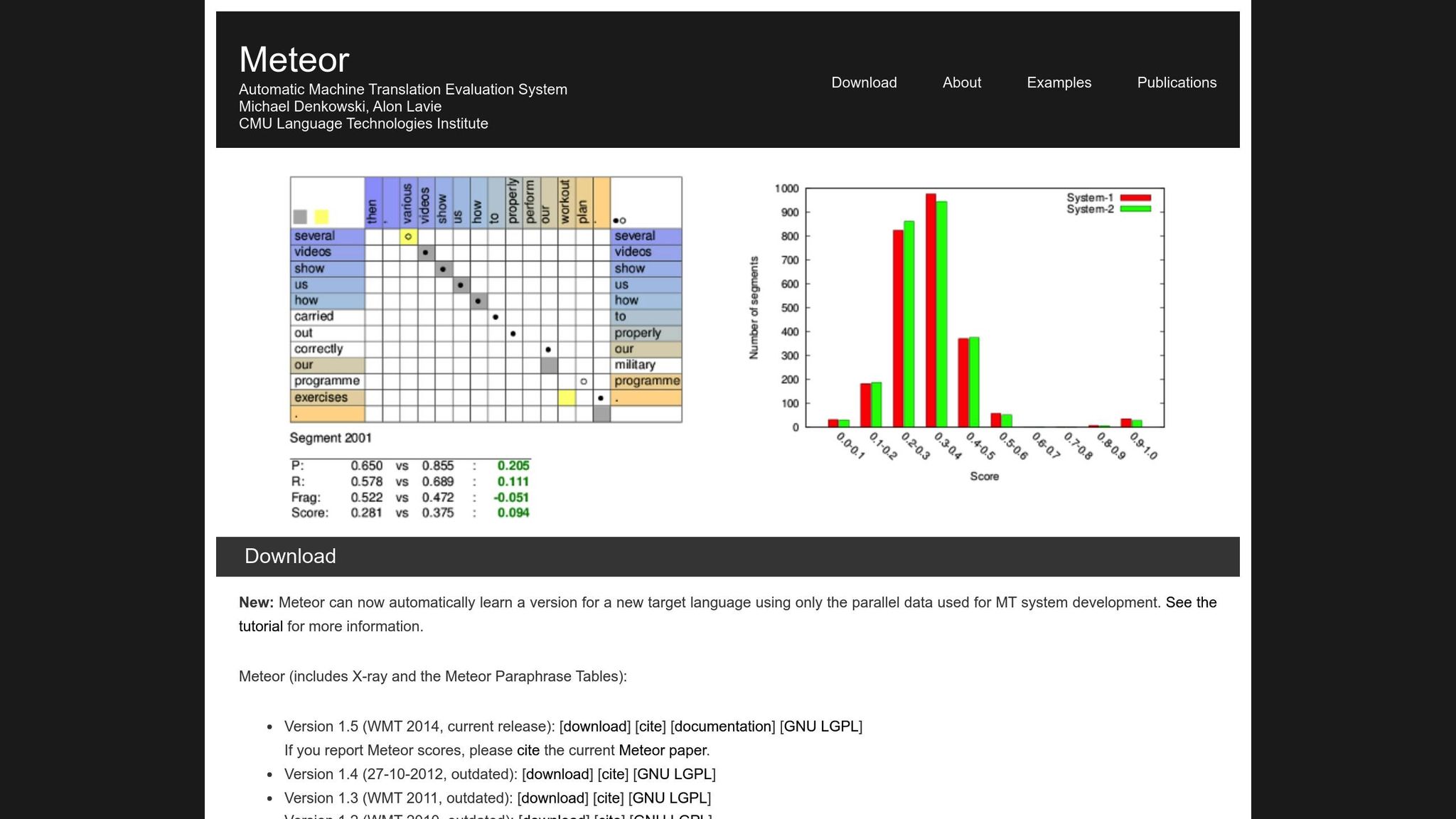

Métrique METEOR

METEOR (Metric for Evaluation of Translation with Explicit ORdering) améliore BLEU en tenant compte de la précision, du rappel, des synonymes, de la racinisation et des pénalités d'ordre des mots [1]. Il gère les variations comme « running » vs « ran » ou « happy » vs « joyful », ce qui le rend mieux adapté aux traductions où le sens est primordial. Par exemple, lors du défi NIST MetricsMaTr10, METEOR‑next‑rank a obtenu une corrélation Spearman rho de 0,92 avec les jugements humains au niveau du système et de 0,84 au niveau du document [1].

Cela dit, METEOR a ses propres défis. Il nécessite des ressources supplémentaires, telles que des bases de données de synonymes et des algorithmes de racinisation, qui augmentent sa charge de calcul. Néanmoins, il fournit souvent une évaluation plus nuancée et fiable, en particulier pour capturer la précision sémantique.

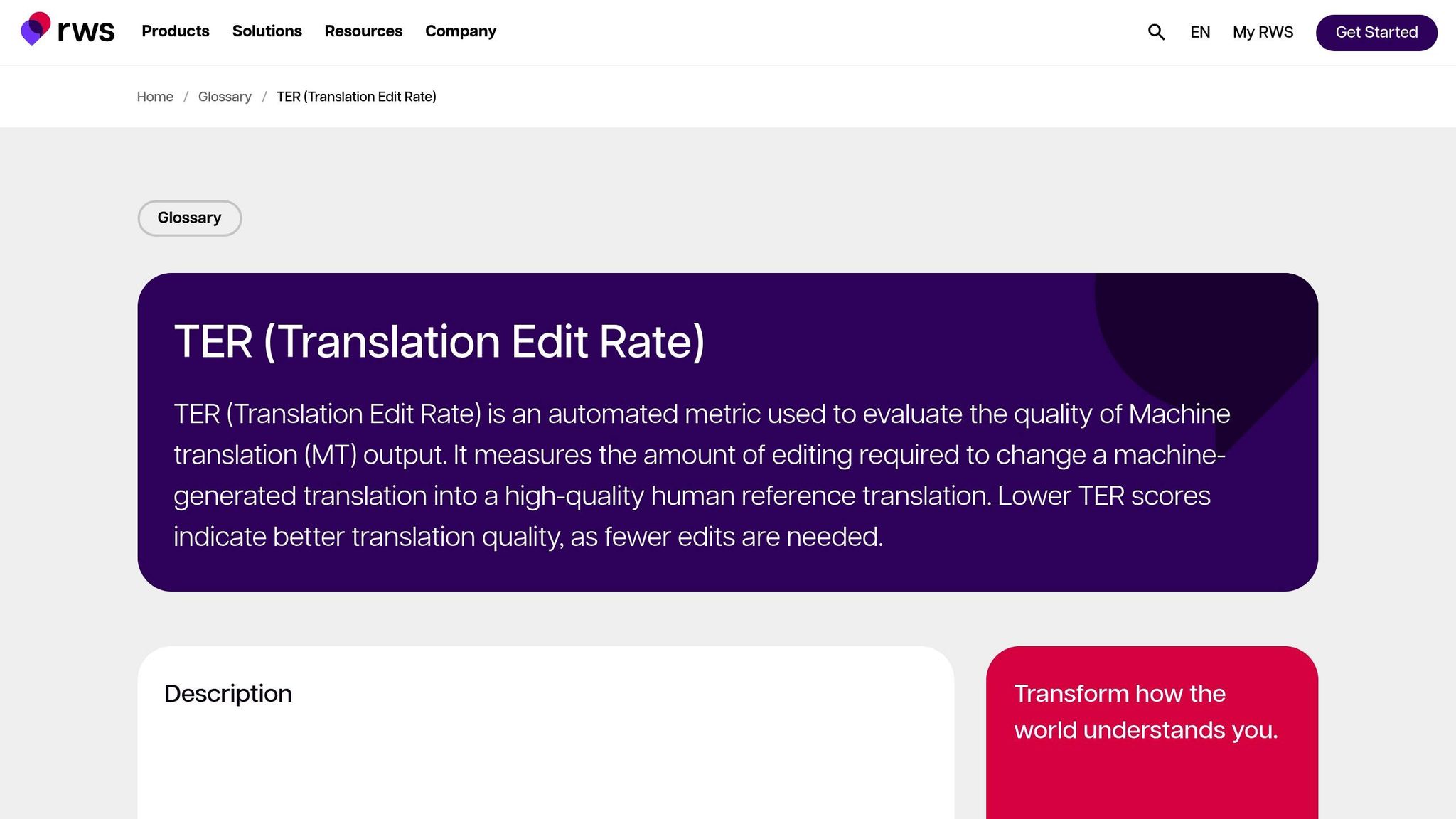

Taux d'édition de traduction (TER)

TER évalue la qualité de la traduction en calculant le nombre d'éditions - insertions, suppressions, substitutions et décalages - nécessaires pour transformer la sortie de la machine en référence. Cela le rend particulièrement utile pour évaluer l'effort d'édition requis pour aligner la sortie avec le résultat souhaité. Dans les évaluations MetricsMaTr10, TER-v0.7.25 a démontré une corrélation au niveau du système de 0,89 avec les évaluations humaines de l'adéquation sémantique, tandis que TERp a montré une corrélation au niveau du segment de 0,68 [1].

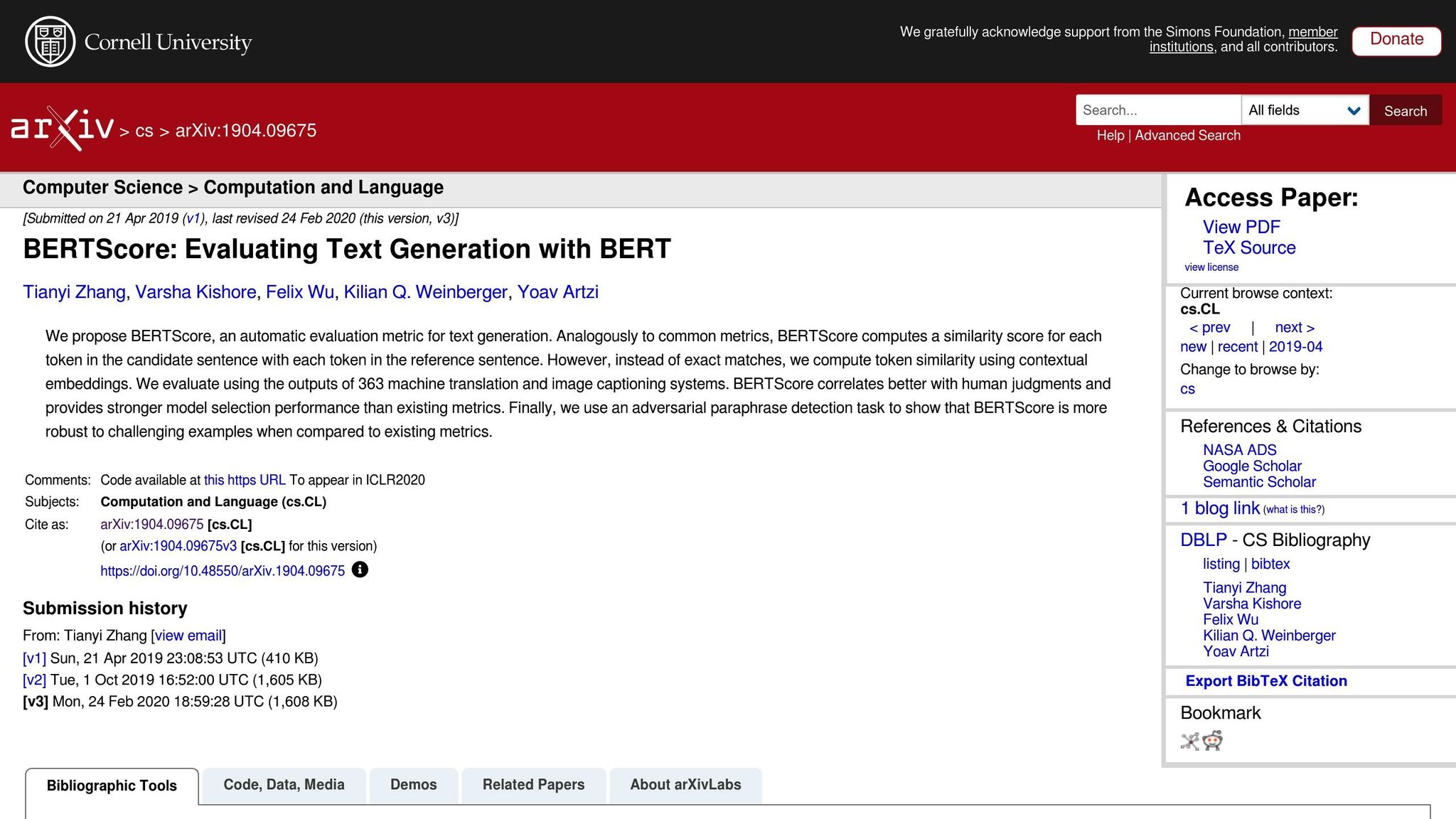

Métriques basées sur les réseaux de neurones : BERTScore, COMET, et GEMBA

Les métriques basées sur les réseaux de neurones poussent l'évaluation de la traduction au niveau suivant en se concentrant sur l'analyse sémantique plutôt que sur les correspondances exactes de mots. Voici un aperçu rapide :

- BERTScore : Utilise les plongements contextuels pour mesurer la similarité entre les traductions.

- COMET : Intègre le texte source, l'hypothèse et les traductions de référence dans un cadre neuronal formé sur des annotations humaines. Il a atteint certaines des plus hautes corrélations avec les jugements de qualité humaine [5].

- GEMBA : Exploite les grands modèles de langage pour l'estimation de qualité sans exemple, offrant une approximation plus proche de l'évaluation humaine.

Bien que ces métriques soient puissantes, elles comportent des compromis. Contrairement à BLEU et TER, qui peuvent s'exécuter sur des processeurs standard en millisecondes, les métriques basées sur les réseaux de neurones comme BERTScore et COMET nécessitent souvent une accélération GPU pour traiter efficacement de grands ensembles de données. GEMBA, en particulier, peut impliquer des coûts d'API élevés et des biais potentiels des grands modèles de langage, ce qui le rend moins accessible pour certains utilisateurs.

Métriques automatiques pour évaluer les systèmes de traduction automatique

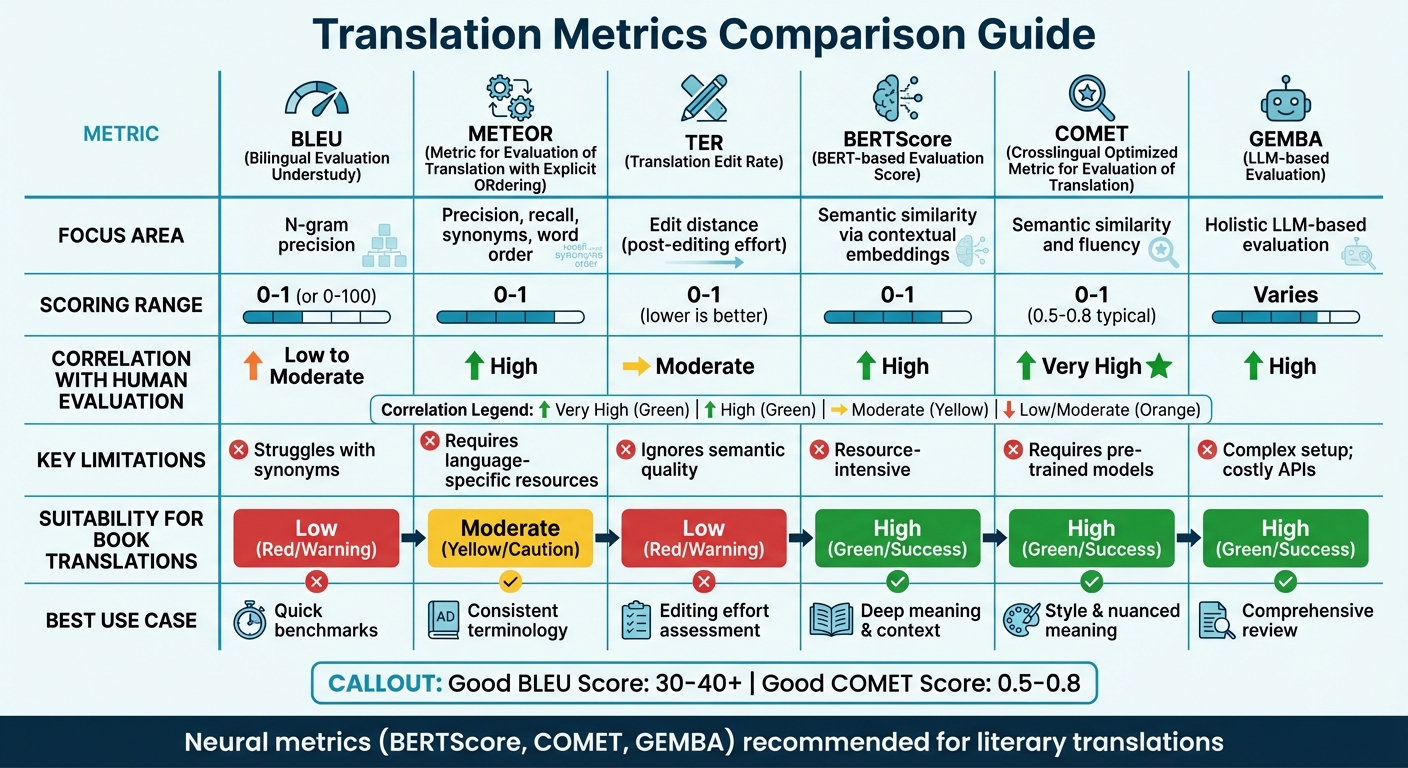

Comparaison des métriques de traduction

Comparaison des métriques de précision de traduction : BLEU, METEOR, TER, BERTScore, COMET et GEMBA

Tableau de comparaison des métriques

Le choix de la bonne métrique de traduction dépend souvent de l'orientation de votre évaluation et des ressources disponibles. Les métriques traditionnelles comme BLEU sont rapides et nécessitent des ressources minimales, mais ont du mal à capturer le sens sémantique plus profond. D'autre part, les métriques neurales excellent à comprendre le contexte et le sens, mais exigent plus de puissance de calcul.

Des recherches récentes suggèrent de s'éloigner des métriques basées sur le chevauchement. Par exemple, les conclusions de WMT22 recommandent d'abandonner les métriques telles que BLEU en faveur des approches neurales [6]. L'étude souligne que les métriques de chevauchement comme BLEU, spBLEU et chrF corrèlent mal avec les évaluations des experts humains.

Voici une comparaison rapide des principales métriques de traduction, couvrant leurs domaines de focus, leurs méthodes de notation, leur corrélation avec l'évaluation humaine, leurs limitations et leur convenance pour les traductions de livres :

| Métrique | Domaine de focus | Plage de notation | Corrélation avec l'évaluation humaine | Limitations | Convenance pour les traductions de livres |

|---|---|---|---|---|---|

| BLEU | Précision des n-grammes | 0 à 1 (ou 0-100) | Faible à modérée | A du mal avec les synonymes [7][8] | Faible ; manque la capacité à capturer le style littéraire |

| METEOR | Précision, rappel, synonymes, ordre des mots | 0 à 1 | Élevée | Nécessite des ressources spécifiques à la langue [7] | Modérée ; utile pour la terminologie cohérente |

| TER | Distance d'édition (effort de post-édition) | 0 à 1 (plus bas est mieux) | Modérée | Ignore la qualité sémantique [7] | Faible ; se concentre sur la mécanique, pas sur la « voix » |

| BERTScore | Similarité sémantique via les plongements contextuels | 0 à 1 | Élevée | Consommatrice de ressources [7] | Élevée ; capture le sens plus profond et le contexte |

| COMET | Similarité sémantique et fluidité | 0 à 1 (0,5-0,8 typique) | Très élevée | Nécessite des modèles pré-entraînés [7][8] | Élevée ; préserve le style et le sens nuancé |

| GEMBA | Évaluation holistique basée sur LLM | Varie | Élevée | Configuration complexe ; API coûteux [7] | Élevée ; offre un examen complet « semblable à l'humain » |

Ce tableau souligne comment les différentes métriques s'alignent avec les besoins spécifiques de traduction. Pour les traductions techniques, les métriques comme BLEU et TER fournissent des repères rapides et basiques. Cependant, pour les traductions littéraires - où le style, le ton et le sens nuancé sont critiques - les métriques neurales comme BERTScore et COMET fonctionnent beaucoup mieux. Ces outils sont particulièrement aptes à capturer la profondeur et l'art des textes littéraires, que les métriques traditionnelles négligent souvent [7].

Par exemple, les plateformes comme BookTranslator.ai, qui visent à équilibrer l'efficacité et la qualité, bénéficient considérablement des métriques neurales. Des outils comme BERTScore et COMET garantissent que la précision sémantique et le style littéraire sont préservés.

Pour mettre les choses en perspective, un score BLEU « bon » se situe généralement entre 30 et 40, les scores au-dessus de 40 étant considérés comme solides, et tout ce qui dépasse 50 indiquant une traduction de haute qualité [8]. Pour COMET, les scores vont généralement de 0,5 à 0,8, les valeurs plus proches de 1,0 reflétant une qualité de traduction quasi-humaine [8]. Les métriques neurales non seulement fonctionnent de manière cohérente sur différents types de textes, mais s'adaptent également mieux aux contextes variables par rapport aux métriques sensibles au domaine comme BLEU [6].

sbb-itb-0c0385d

Méthodes d'évaluation humaine

Les métriques automatisées peuvent offrir la rapidité et la cohérence, mais elles manquent souvent les détails subtils qui définissent la qualité de la traduction. C'est là que l'évaluation humaine intervient comme l'étalon-or[2]. Bien qu'elle soit plus lente et plus coûteuse, l'évaluation humaine découvre les raisons plus profondes des problèmes de qualité - des choses que les métriques comme BLEU ou COMET ne peuvent tout simplement pas identifier[9].

Il y a deux approches principales à l'évaluation humaine. L'une est le Jugement directement exprimé (DEJ), où les traductions sont évaluées sur des échelles comme la fluidité et l'adéquation. L'autre implique des méthodes non-DEJ, qui se concentrent sur le repérage et la catégorisation des erreurs spécifiques, souvent en utilisant des cadres comme MQM[12]. Tandis que les méthodes analytiques décomposent les erreurs individuelles et leur gravité, les méthodes holistiques examinent la qualité globale. Ensemble, ces approches forment l'épine dorsale de cadres comme MQM.

MQM (Métriques de qualité multidimensionnelles)

Quand les outils automatisés ne suffisent pas, MQM offre une alternative plus détaillée et exploitable. Il divise les erreurs de traduction en catégories comme l'exactitude, la fluidité, la terminologie, les conventions régionales et la conception/balisage, plutôt que de résumer la qualité avec un seul chiffre[18, 17].

« En contraste, les métriques automatisées fournissent généralement juste un chiffre sans indication de comment améliorer les résultats. »

– Comité MQM[10]

Les erreurs sont évaluées par gravité : Neutre (signalée mais acceptable, pas de pénalité), Mineure (légèrement perceptible, poids de pénalité de 1), Majeure (affecte la compréhension, poids de pénalité de 5), et Critique (rend le texte inutilisable, poids de pénalité de 25)[11]. Pour les traductions critiques, comme les documents juridiques, les seuils de passage peuvent être fixés aussi haut que 99,5 sur une échelle de score brut[11].

Ce qui rend MQM particulièrement utile, c'est sa capacité à identifier les domaines de problèmes spécifiques. Par exemple, si une traduction littéraire obtient un mauvais score, MQM peut révéler si le problème réside dans une formulation maladroite ou une terminologie incohérente. Ce niveau de détail est particulièrement précieux pour les plateformes comme BookTranslator.ai, où capturer à la fois le sens et le style littéraire est essentiel.

Notation de l'adéquation et de la fluidité

S'appuyant sur des cadres structurés comme MQM, les évaluateurs se concentrent également sur deux dimensions clés de la qualité de traduction : l'adéquation et la fluidité. L'adéquation mesure la qualité avec laquelle la traduction transmet le sens du texte source, tandis que la fluidité évalue sa naturalité et sa lisibilité pour les locuteurs natifs. Ces aspects sont souvent notés sur des échelles à cinq points[9].

Équilibrer ces deux dimensions peut être délicat, en particulier dans les traductions littéraires. Préserver la voix de l'auteur original tout en veillant à ce que le texte se lise bien dans la langue cible exige une attention particulière.

Pour affiner ce processus, les évaluateurs utilisent l'évaluation directe (DA), qui note les traductions dans des formats monolingues, bilingues ou basés sur des références[9]. La métrique de qualité scalaire (SQM) va plus loin avec une échelle à sept points, permettant aux évaluateurs d'évaluer les segments individuels dans le contexte du document entier. Pour les livres, cette orientation contextuelle est critique - la qualité dépend souvent de la qualité avec laquelle un chapitre développe les personnages ou maintient la continuité de l'intrigue.

Utilisation des métriques pour la traduction de livres

La traduction de livres est un défi unique. Contrairement aux manuels d'instructions ou aux matériaux de marketing, les livres exigent un équilibre entre la précision sémantique - garantir que le sens est correct - et la préservation du style - maintenir la voix et le ton de l'auteur. L'évaluation des traductions de livres exige une approche adaptée, avec des métriques choisies pour convenir au type spécifique de contenu traduit.

Traductions techniques vs littéraires

Toutes les traductions de livres n'ont pas les mêmes exigences. Les textes techniques, tels que les matériaux académiques ou pédagogiques, privilégient la précision et la cohérence. Pour ceux-ci, des métriques comme TER (Taux d'édition de traduction) sont particulièrement efficaces, car elles mesurent la quantité d'édition nécessaire pour perfectionner la traduction.

Les œuvres littéraires, en revanche, sont une autre histoire. Les romans, les mémoires et les genres similaires reposent fortement sur le flux narratif et la résonance émotionnelle. Dans ces cas, METEOR se distingue parce qu'il tient compte des synonymes et des différences sémantiques subtiles, atteignant des corrélations avec les évaluations humaines aussi élevées que 0,92 au niveau du système