书籍翻译中的人工智能伦理

人工智能通过提高速度和降低成本改变了书籍翻译,但也引入了伦理问题。虽然神经机器翻译(NMT)和机器翻译后期编辑(MTPE)等人工智能工具使作者和出版商能够以极低的成本和时间进行书籍翻译,但它们往往在习语、语调和文化参考等细微差别上存在困难。这可能导致翻译不准确、输出有偏见以及作者风格丧失。

主要挑战包括:

- 准确性:人工智能经常遗漏幽默、隐喻和情感深度等细微之处。

- 偏见:训练数据可能强化刻板印象,如性别角色,并使代表性不足的语言边缘化。

- 问责制:在没有人工监督的情况下,人工智能可能会改变原文的含义。

- 版权:作者必须保护自己的权利,因为人工智能系统可能在未经同意的情况下使用受版权保护的作品。

解决方案在于将人工智能与人类专业知识相结合。通过使用MTPE,人类翻译人员完善人工智能草稿,以确保质量同时保留作者的意图。伦理实践,如使用多样化的训练数据、保护知识产权和保持透明度,对于公平准确的翻译至关重要。虽然人工智能提高了效率,但人工监督对于保留文学作品的深度和完整性仍然至关重要。

翻译中的人工智能是伦理的还是仅仅更便宜?

sbb-itb-0c0385d

人工智能书籍翻译中的准确性挑战

人工智能翻译挑战:准确性和文化问题的调查结果

翻译准确性意味着什么

翻译正确不仅仅是一个技术难题——它关乎忠实于作者的意图。书籍翻译中的准确性超越了逐字正确性。它是关于保留原作的含义、风格和背景。一个技术上正确但错过了文本语调或情感分量的翻译会显得空洞而不完整。

文学作品依赖于细微差别。讽刺作家的尖锐幽默或爱情小说家的诗意流畅承载了他们叙事的本质。当翻译人员捕捉到这些元素时,他们保留了作品的身份。人类翻译人员为他们的工作带来创意和判断力,做出有意的选择以反映文本的更深层次。另一方面,人工智能经常产生在语言上准确但缺乏情感或文体深度的翻译,无法真正反映原文[1][3]。

在处理承载重大文化或情感分量的表达时,这些挑战变得更加明显,如下所述。

人工智能在哪里与背景作斗争

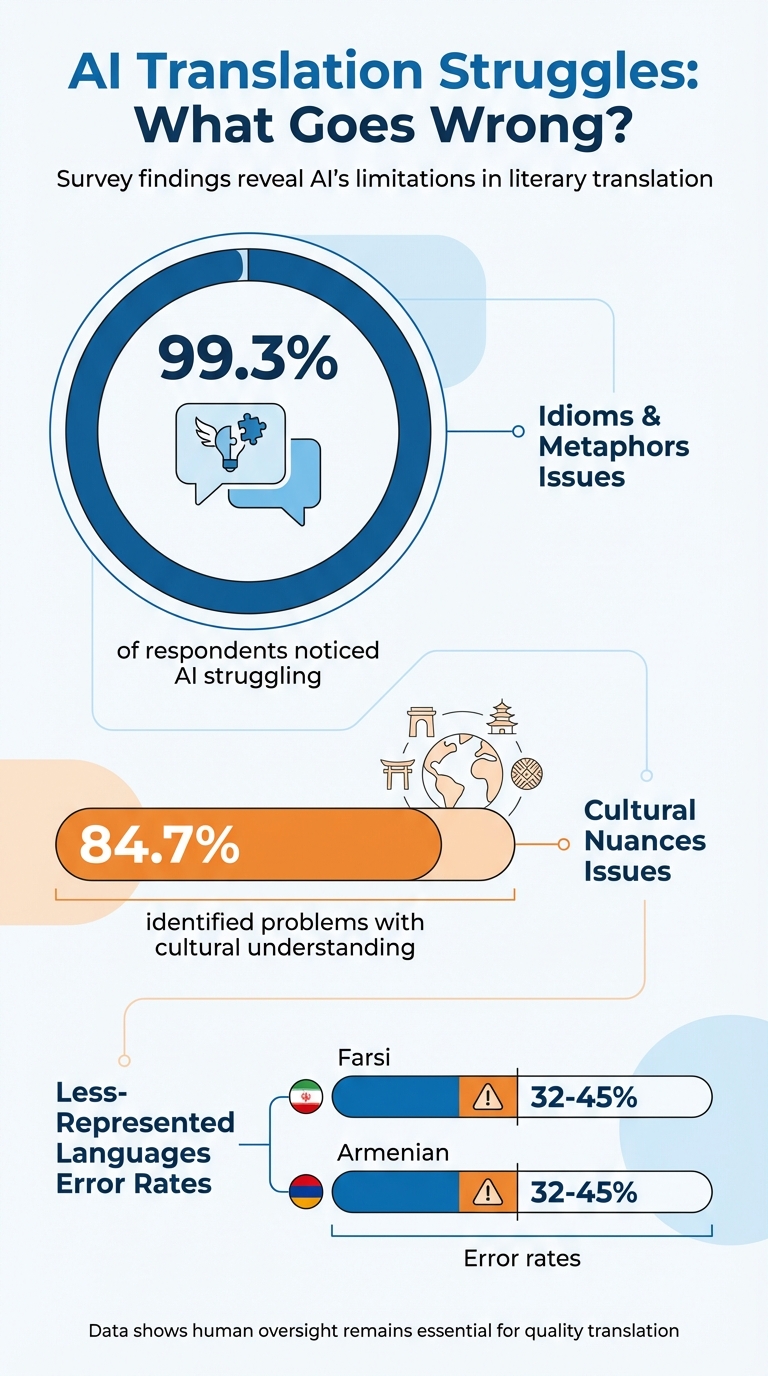

当处理习语、隐喻、文化参考和复杂句子结构时,人工智能面临最大的困难。最近的一项调查发现,99.3%的受访者注意到人工智能在习语和隐喻方面存在困难,而84.7%的人指出文化细微差别存在问题[1]。这些差距突出了人工智能在把握更深层含义方面的困难。

地区方言增加了另一层复杂性。人工智能经常产生生硬、过度字面的翻译,剥离了这些方言的文化丰富性。翻译专家Liesl Yamaguchi指出,不良的人工智能翻译可能会造成虚假的易用性感,掩盖了对真正文学理解的需要[2]。

对于代表性不足的语言,挑战甚至更大。有限的训练数据导致波斯语和亚美尼亚语等语言的错误率高达32-45%[4]。这不仅导致翻译不准确,还通过无法准确代表全球南方的声音而加剧不平等。这些声音充满文化和文学意义,应得到尊重其完整性的翻译。

这些不足强调了人工参与的重要性,以确保文学作品保留其真实性和深度。仅凭人工智能还无法达到这个标准。

人工智能翻译中的偏见和代表性

人工智能训练数据中的偏见从何而来

人工智能翻译系统建立在大规模数据集的基础上,通常来自书籍、网站和预先存在的翻译。问题是什么?这些数据集可能反映社会偏见和文化失衡,人工智能随后将其学习为"正常"。例如,神经机器翻译(NMT)系统经常依赖于可能已经带有文化偏见的受版权保护的文学作品和人工翻译[5]。

最明显的例子之一是性别刻板印象。研究表明,Google翻译等工具经常默认为刻板印象,例如从性别中立的语言翻译"他工作,她做饭"[5]。一个案例:在土耳其语中,性别中立短语"O bir doktor"(他们是医生)经常被翻译为"他是医生",而"O bir hemşire"(他们是护士)变成"她是护士"[6]。这发生是因为训练数据缺乏性别平衡,强化了过时的角色。

除此之外,算法处理可能会剥离文化细微差别,甚至在原文避免时也强化现有的社会等级制度[5]。岭南大学研究员Bo Li强调了这里的伦理挑战:"版权伦理是人工智能启用的文学翻译中不可或缺的一部分,因为训练数据和参与式NMT涉及版权问题"[5]。人工智能后期编辑也可能简化或使语言风格同质化,这冒着失去原作者独特声音的风险。这种风格的扁平化破坏了准确翻译所需的文学丰富性。

最终,这些偏见不仅停留在训练数据中——它们塑造了最终产品,影响角色、主题和文化细微差别的呈现方式。

偏见如何影响文学翻译

有偏见的翻译的影响远超尴尬的措辞。它们可以从根本上改变角色的感知方式、扭曲主题并消除文化深度。例如,当人工智能根据刻板印象为中性代词分配性别时,专业角色通常默认为过时的规范。医生通常被呈现为男性,而护士或助手通常是女性[6]。这些假设可能会显著影响读者对角色及其角色的看法。

文化表达也受到打击。考虑一个日本角色用谦虚的短语礼貌地拒绝邀请。人工智能可能会将其翻译为生硬的"不",这可能会使角色显得粗鲁而不是尊重[6]。政治语言是另一个雷区。例如,一种语言中的"自由战士"一词如果人工智能的训练数据倾向于特定的政治偏见,可能会被翻译为"恐怖分子"[6]。

"人工智能可能很快,但它不理解后果。只有人类才能评估翻译是否适合特定的受众或情况。" – Gergana Toleva,1StopAsia[6]

因为人工智能训练数据经常过度代表主导文化,少数民族声音和方言被推向边缘。这导致翻译作品中文化多样性的"扁平化",其中不同的地区表达和代表性不足的语言失去活力[6]。对于作者和出版商来说,这不仅仅是一个创意问题——这是一个真实的风险。有偏见的翻译可能导致公众反弹、损害声誉,甚至如果内容被视为冒犯或歧视性,可能引发法律麻烦[6]。

问责制和人工监督

将人工智能与人类翻译人员相结合

在伦理人工智能翻译的世界中,机器翻译后期编辑(MTPE)已成为黄金标准。这种方法将人工智能的速度与人类翻译人员的专业知识相结合。人工智能产生初始草稿,专业人士对其进行完善,确保最终产品精良准确。结果是什么?更快的周转时间而不牺牲质量。

该过程分几个关键步骤进行。首先,双语编辑审查人工智能的输出以及原文,重点是捕捉算法经常遗漏的细微差别。他们还改编习语、幽默和其他文化特定元素,以确保翻译按预期产生共鸣。接下来,校对员介入,纠正打字错误和标点符号等技术问题。必要时,母语测试读者增加额外的审查层,确保保留原文的情感深度。

"解决方案在于精心编排的合作,利用两个世界的最佳方面。" – Translated.com [7]

为了保持一切一致,编辑依赖于在项目开始前建立的风格指南和词汇表。清洁的EPUB文件也至关重要,因为它们防止可能引入错误的隐藏格式问题。这种结构化合作确保保留叙事的本质,同时维持技术准确性。

将问责制纳入人工智能工作流程

现代翻译平台现在正在使用先进的指标来衡量人工智能与人类合作的效率和准确性。例如,编辑时间(TTE)跟踪编辑每个片段所花费的秒数,而每千字错误数(EPT)衡量每1,000个单词中的客观错误数[7]。这些指标提供了对工作流质量的清晰见解。

一些系统进一步采用T-Rank等人工智能驱动的工具,将编辑与特定的类型专业知识相匹配。这确保审阅者非常适合文本的独特需求。反馈循环也发挥关键作用——编辑更正被反馈到系统中,帮助人工智能学习并随着时间的推移减少重复出现的错误。

像BookTranslator.ai这样的平台已采纳这些问责措施,在人工智能和人类专家之间创造无缝伙伴关系。通过让人工智能处理重复性任务,人类翻译人员可以专注于工作的创意和细微方面。这确保每项翻译都保持技术精确性,同时尊重原文的情感和艺术完整性。

知识产权和作者权利

人工智能翻译中的版权问题

人工智能生成的翻译通常导致版权法定义的"衍生作品",这意味着作者必须保留对这些翻译的控制权及其使用方式。当考虑人工智能系统如何被训练时,这变得更加复杂。许多大型语言模型依赖于从互联网抓取的巨大数据集,其中可能包括在未经作者或出版商适当同意的情况下使用的受版权保护的文学作品[9][5]。

另一个关键问题是数据安全。消费级人工智能工具可能会将提交的文本用于训练目的,可能会暴露未发表的手稿或其他敏感材料[9]。为了避免这些风险,作者和出版商应选择明确保证非训练政策并提供强加密以保护知识产权的企业级工具。像欧洲文学翻译人员协会委员会这样的倡导组织正在推动更强的保护,因为围绕人工智能生成内容的法律继续发展[9]。

"人工智能采用的未来取决于信任、伦理和人类专业知识。" – Slator [9]

为了进一步保护你的工作,确保服务协议规定你保留翻译内容的完全所有权。为每个语言版本获得唯一的ISBN,并将外国许可限制在特定地区和5-7年的期限。虽然法律措施有助于保护所有权,但保留作者独特的声音需要仔细的编辑关注。

使用人工智能保留作者的声音

保护作者的创意表达超越了法律权利——它是关于保留他们独特的艺术风格。

人工智能系统在确保术语一致性方面表现出色,跨越冗长的手稿,但在捕捉使作者作品脱颖而出的创意元素时往往不足。文字游戏、双关语和高度风格化的散文等特征对人工智能来说很难准确复制[8]。情感深度和文化细微差别也需要人类专业知识的触及。

准备是保留作者声音的关键。从创建基本术语、角色名称和设置的词汇表开始,并制定详细的风格指南,概述语调、语音模式和其他风格元素。这有助于人工智能工具和人类编辑都忠实于作者的原始意图。使用清洁、验证的EPUB文件而不是Word文档也可以保留重要的格式,如斜体和结构元素。最后,涉及双语编辑和母语测试读者,以确保翻译保留其情感共鸣和文化背景。

伦理人工智能书籍翻译的最佳实践

人工智能翻译中的透明度

问责制和透明度在伦理人工智能翻译中携手并进。对于读者和作者来说,理解人工智能如何做出翻译决定至关重要。可解释的人工智能可以阐明为什么选择某些单词、短语或解释。这种清晰度不仅建立信任,还允许本地化管理人员及早发现潜在问题。

例如,如果作者知道人工智能擅长保持一致的术语但可能在习语表达或微妙的文化参考方面失败,他们可以计划在必要时进行人工编辑输入。机密性是另一个关键问题——应该制定严格的数据处理政策,以确保作者他们的手稿不会被重新用于进一步的人工智能训练。这些透明度实践共同确保人工智能增强而不是削弱文学翻译的精细艺术。它们也补充了早期解决偏见和监督等问题的努力。

为人工智能平台创建伦理指南

为了加强伦理人工智能翻译实践,清晰而稳健的指南是不可或缺的。保留作者的声音和准确传达背景取决于坚实的伦理框架。一个强有力的起点是关注训练数据——高质量、多样化的数据集对于减少偏见和提高准确性至关重要,特别是对于代表性不足的语言。训练人工智能处理整个文档而不是孤立的句子也有助于保持叙事连贯性和作者的独特风格。

将熟练的双语编辑纳入该过程是另一个关键步骤。这些专业人士可以确保文化细微差别得到尊重,任何偏见都得到解决。正如坦佩雷大学教授Kaisa Koskinen所恰当指出的:

"伦理永远无法一劳永逸地解决,因为道德方面需要不断重新协商,条件和情况会改变。" [10]

平台还应通过保证作者保留人工智能辅助翻译的完整版权所有权来保护知识产权。词汇表、验证的EPUB文件和结构化的两层审查系统等工具可以进一步保护作者在整个翻译过程中的创意声音。

结论:人工智能书籍翻译伦理的未来

关键要点

伦理人工智能书籍翻译取决于三个主要原则:准确性、问责制和公平代表性。实现背景准确性意味着捕捉文本的完整本质,包括其语调和文化细微差别。当人类专家与人工智能合作完善其输出时,问责制蓬勃发展。公平代表性需要平衡的训练数据以防止少数民族语言的边缘化并避免强化刻板印象。这些元素共同有助于建立对人工智能驱动翻译的信任。

这些原则为人工智能翻译的未来奠定了基础。

人工智能翻译的下一步是什么

伦理人工智能翻译的未来正在通过开发在精心选择的文学数据集上训练的专门大型语言模型而形成。这种转变优先考虑训练材料的质量和多样性,而不是简单地推进算法复杂性。通过纳入持续学习——系统根据现实世界的使用和人类反馈进行适应——翻译工具可以与文化和语言变化保持一致。这些进步与通过伦理指