Så, vad är neuralmaskintranslation? I enkla termer, det är en AI-baserad metod som översätter hela meningar på en gång. I stället för att byta ord ett i taget tittar den på hela sammanhanget för att skapa översättningar som låter naturliga och flytande. Det är ett enormt steg framåt från äldre system som ofta gav oss klumpiga, inexakta resultat.

Ett smartare sätt att översätta vår värld

Tänk på att översätta en engelsk idiom som "it's raining cats and dogs" till spanska. En bokstavlig, ord-för-ord-översättning skulle ge está lloviendo gatos y perros, vilket skulle vara helt meningslöst för en modersmålstalare. En människa, å andra sidan, förstår betydelsen och skulle välja en naturlig motsvarighet, som está lloviendo a cántaros (det regnar kannor).

Det är exakt den sortens språng som NMT gör. Det är utformat för att förstå sammanhang, nyans och avsikt, ungefär som en person gör, snarare än bara att matcha ord från en ordbok.

Bortom den digitala ordboken

Under lång tid var maskintranslation ganska primitiv. De första försöken använde strikta grammatikregler eller statistiska modeller, som i princip bara var mycket sofistikerade digitala ordböcker. De skulle dela upp meningar, översätta bitarna separat och sedan försöka sätta ihop dem igen. Resultaten kändes vanligtvis robotiska och var ofta helt enkelt fel.

Neuralmaskintranslation är ett helt annat spel. Det använder en komplex modell inspirerad av den mänskliga hjärnan—ett neuralt nätverk. Det här nätverket tränas på massiva mängder text som redan har översatts professionellt, vilket lär det att se mönster, grammatiska strukturer och till och med vardagliga fraser.

Den här metoden ger några stora fördelar:

- Kontextuell noggrannhet: Det kan räkna ut den korrekta betydelsen av ett ord med flera definitioner, som om "bank" hänvisar till en flodkant eller en finansiell institution, genom att titta på resten av meningen.

- Förbättrad flytande: Den slutliga texten läses mycket smidigare eftersom AI lär sig att bygga meningar på det sätt en modersmålstalare faktiskt skulle göra det.

- Kontinuerligt lärande: NMT-modeller blir bättre och bättre över tid. Ju mer högkvalitativ data de behandlar, desto mer exakt blir deras översättningar.

I sitt hjärta handlar NMT om att gå från bokstavlig ordbyte till holistisk betydelseöverföring. Det är skillnaden mellan en enkel miniräknare och en matematiker som förstår principerna bakom siffrorna.

Varför NMT är viktigt för alla

Den här teknologin är inte bara ett intressant laboratorieexperiment längre; det är ett verktyg som formar hur vi interagerar varje dag. För en oberoende författare är det en spelväxlare. Det gör det både överkomligt och praktiskt att översätta en bok för en global publik. Plattformar som BookTranslator.ai låter till och med skapare översätta hela e-böcker samtidigt som de behåller sin unika röst och original formatering intakt.

Det hjälper också studenter och forskare att få tillgång till akademiska artiklar från överallt i världen, vilket rivs ned gamla barriärer för kunskap. Från att driva realtidschatstöd till att hjälpa företag att lokalisera sina webbplatser, är det väsentligt för alla som kommunicerar i vår anslutna värld att förstå neuralmaskintranslation. Den här guiden går dig igenom dess historia, tekniken som gör det möjligt och hur du kan sätta det i arbete.

Från kodböcker till kognition: Den långa vägen till AI-översättning

Drömmen om en universell översättare är inte ny. Den började faktiskt under Kalla kriget, driven av det brådskande behovet av att förstå utländsk kommunikation på flykt. Det startade de mycket första experimenten inom maskintranslation, och även om ambitionen var enorm var de första resultaten... ja, lite klumpiga.

Grammatikbokstillvägagångssättet: Regelbaserad MT

De tidigaste systemen använde ett tillvägagångssätt som vi nu kallar Regelbaserad maskintranslation (RBMT). Föreställ dig att ge en dator en massiv tvåspråkig ordbok och en omfattande grammatiklärobok för två språk. Det är i princip vad RBMT var. Lingvister och programmerare tillbringade otaliga timmar med att handcraft intrikata regler för grammatik, syntax och ordförråd.

Datorn skulle sedan mekaniskt byta ord och tillämpa dessa stela regler. Det berömda Georgetown-IBM-experimentet 1954, som översatte över 60 ryska meningar till engelska, var ett landmärke. Men det avslöjade också den dödliga bristen i denna metod. Språk är röriga och fullt av idiom, undantag och sammanhang—saker som en strikt uppsättning regler bara inte kan hantera. Översättningarna var ofta löjligt bokstavliga och knappt användbara.

En ny idé: Spela oddsen med statistik

På 1990-talet tog ett helt annat sätt att tänka fäste. I stället för att lära en dator språkliga regler, varför inte bara visa den massor av exempel? Det här var idén bakom Statistisk maskintranslation (SMT). Forskare matade datorer med massiva bibliotek av människöversatt text, kallad parallella korpora, och sa i princip åt dem att hitta mönstren.

SMT fungerade genom att dela upp meningar i mindre bitar av ord (kända som "n-gram") och beräkna den mest sannolika översättningen för varje bit baserat på de data den hade sett. Det var som en kodbrytare som räknade ut vilken fras på ett språk som oftast motsvarade en fras på ett annat. Det var ett stort steg framåt från RBMT och producerade mycket mer naturligt klingande översättningar.

Ändå var det inte perfekt. SMT-modeller hade ett mycket kort minne. Eftersom de översatte i isolerade fragment kämpade de ofta med den övergripande meningens flytande och komplexa grammatik. Den slutliga utgången kunde kännas lite sammanförd, som ett lapptäcke av fraser som inte helt passade ihop.

Det stora språnget: Neurala nätverk lär sig att "förstå"

Den verkliga spelväxlaren kom runt 2014 med neuralmaskintranslation (NMT). Det var inte bara en förbättring; det var ett helt nytt sätt att tänka. I stället för att memorera regler eller statistiska sannolikheter använder NMT artificiella neurala nätverk—system utformade för att efterlikna hur den mänskliga hjärnan bearbetar information—för att lära sig språk.

Det var ett enormt genombrott, särskilt efter decennier av långsam framgång och stora motgångar som ALPAC-rapporten från 1966. Den rapporten drog slutsatsen att maskintranslation var en återvändsgränd, vilket satte tillbaka området i många år. För att verkligen uppskatta resan är det värt att utforska en detaljerad tidslinje över dessa tidiga översättningsförsök.

Kärneskillnaden är att NMT var det första tillvägagångssättet där en maskin lärde sig att översätta genom att förstå betydelsen av en mening, inte bara genom att byta ut ord eller fraser. Det läser hela källtexten för att fånga kärnidén innan det ens börjar skriva måltexten.

Den här holistiska metoden är vad som gör att NMT-modeller kan tackla knepig grammatik, helt ordna om en mening för att få den att låta naturlig på målspråket och plocka upp subtil sammanhang. När Googles Neural Machine Translation (GNMT) system lanserades 2016 var det ett vattendrag. Det minskade översättningsfel med över 60 % jämfört med de bästa statistiska systemen.

Det här enorma språnget i kvalitet är varför AI-översättningen vi använder idag känns så flytande och pålitlig. Det är kulmen på en lång, ofta frustrerande resa från stela regler till genuin förståelse.

Hur AI lär sig att förstå och översätta språk

För att verkligen förstå vad neuralmaskintranslation är måste du titta under huven på hur AI "tänker". Det är inte bara att slå upp ord i en digital ordbok eller följa en stel grammatikregel. I stället använder det ett komplext system, löst inspirerat av våra egna hjärnor, för att förstå den faktiska betydelsen och kontexten för en mening.

Hela systemet är byggt omkring en kraftfull idé som kallas encoder-decoder-arkitektur. Föreställ dig en skicklig mänsklig tolk som lyssnar intensivt på en talare innan han översätter. Det är en bra analogi för vad som händer här.

Först spelar kodaren lyssnaren. Den läser en helt mening på källspråket—säg, engelska—och arbetar för att förstå den. Dess mål är inte en ord-för-ord-omvandling utan att destillera meningens kompletta betydelse, nyans och avsikt till en rent matematisk form. Denna abstrakta sammanfattning, en tät vektor av siffror, innehåller essensen av den ursprungliga idén.

Sedan tar avkodaren över som talaren. Den ser aldrig de ursprungliga engelska orden. Det tittar bara på den komprimerade matematiska betydelsen och använder den för att bygga en helt ny mening på målspråket, som franska, från grunden. Det här är hemligheten bakom varför NMT kan omformulera idéer och blanda ordordning för att låta naturlig, vilket undviker de stela, bokstavliga översättningarna från äldre system.

Kraften i att uppmärksamma

Tidiga encoder-decoder-modeller hade ett stort problem. De var tvungna att pressa betydelsen av en mycket långt mening i en fast paket. Det var som att försöka sammanfatta en hel roman i en enda tweet. Oundvikligen skulle avgörande detaljer gå förlorade, särskilt i längre, mer komplexa meningar.

Det här är där uppmärksamhetsmekanismen kom in och förändrade allt. Uppmärksamhetsmekanismen ger avkodaren en superkraft: förmågan att "titta tillbaka" på den ursprungliga meningen och fokusera på de mest relevanta orden vid varje steg i översättningsprocessen.

Så när det är dags att generera ett specifikt ord i den nya meningen kan avkodaren uppmärksamma de delar av källtexten som är mest kritiska för det ordet sammanhang. Det här låter systemet hantera långdistansberoenden och knepig grammatik med mycket större noggrannhet.

Tänk på uppmärksamhetsmekanismen som att ge AI en markör. Medan den skriver den översatta meningen kan den markera de viktigaste orden i originaltexten och se till att ingen avgörande detalj förbises.

Det sätt på vilket en AI lär sig att översätta är konceptuellt liknar hur vi människor plockar upp ett nytt språk. Det förlitar sig på massiva mängder data, som fungerar ungefär som konceptet förståelig input för en mänsklig elev. Ju fler högkvalitativa exempel AI ser, desto bättre blir det på att hitta dessa komplexa mönster.

Transformer-revolutionen

Med utgångspunkt i dessa idéer markerade Transformer-modellen, introducerad 2017, ett annat enormt språng framåt. Tidigare modeller var tvungna att bearbeta text sekventiellt—ett ord efter ett annat. Transformer kan dock bearbeta alla ord i en mening samtidigt. Den här parallella bearbetningen gör den otroligt snabb och effektiv.

Transformers överladade också uppmärksamhetsmekanismen. Det här gör att modellen kan väga vikten av varje enskilt ord i indatatexten mot varje annat ord, vilket skapar en otroligt djup kontextuell förståelse. Det är denna kraftfulla arkitektur som driver dagens mest avancerade AI-översättningssystem, vilket gör det möjligt för dem att producera anmärkningsvärt flytande och exakta resultat.

Den här resan från klumpiga, regelbaserade system till sofistikerade neurala nätverk är vad som har definierat modern översättningsteknik. För att sätta denna utveckling i perspektiv, här är en snabb jämförelse av de tre stora epoker inom maskintranslation.

Maskintranslationsmetoder på ett ögonkast

| Funktion | Regelbaserad (RBMT) | Statistisk (SMT) | Neural (NMT) |

|---|---|---|---|

| Kärnprincip | Mänskligt kodade grammatikregler och ordböcker. | Sannolikhetsmodeller baserade på statistisk analys av stora tvåspråkiga texter. | Djupinlärningsmodeller som lär sig mönster från enorma mängder data. |

| Översättningskvalitet | Bokstavlig, ofta klumpig och grammatiskt felaktig. | Mer flytande än RBMT men kan låta onaturlig och kämpa med sällsynta fraser. | Mycket flytande, kontextmedveten och ofta mänsklig. |

| Sammanhang hantering | Mycket dålig; översätter ord-för-ord eller fras-för-fras. | Begränsat till fraser och statistisk samförekomst. | Utmärkt; förstår hela meningens sammanhang. |

| Idiom & nyans | Misslyckas helt; producerar meningslösa bokstavliga översättningar. | Kan ibland få det rätt om idiom är vanligt i träningsdata. | Mycket bättre på att tolka och översätta bildligt språk. |

| Databehov | Kräver språkexperter för att skapa och underhålla regler. | Behöver massiva, parallella korpora (anpassade tvåspråkiga texter). | Behöver ännu större datauppsättningar än SMT men kan också lära sig från enspråkig data. |

Som du kan se byggde varje generation på den förra, med NMT som representerar en grundläggande förskjutning mot att förstå betydelse snarare än bara att byta ord.

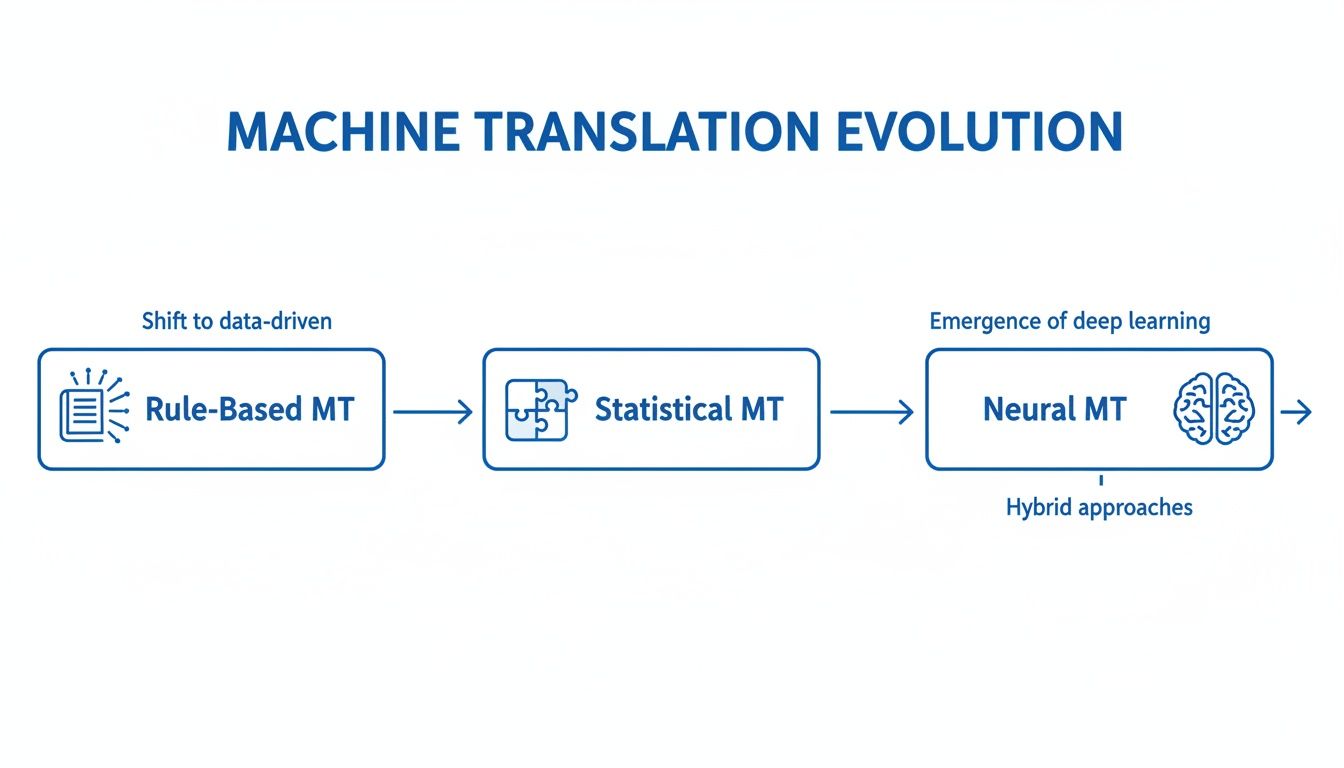

Infografiken nedan visualiserar denna resa från stela ordböcker till intelligent, kontextmedveten AI.

Det här visuella visar den tydliga utvecklingen från enkla regelbaserade metoder till den komplexa, hjärnliknande arkitekturen för neurala nätverk, vilket framhäver den ökande sofistikering av maskintranslation över tid.

NMT i den verkliga världen: Från böcker till affärer

Det är en sak att tala om teori, men det är i den verkliga världen som neuralmaskintranslation verkligen kommer till liv. NMT är inte längre bara ett fascinerande koncept gömt i forskningslaboratorier; det förändrar aktivt hur vi alla kommunicerar. Det bryter ner språkbarriärer för företag och öppnar helt nya dörrar för skapare. Du kan se dess arbete överallt, från e-böckerna på din surfplatta till kundstödschaten du har online.

Det denna teknologi har gjort är att göra högkvalitativ översättning mer tillgänglig och överkomlig än någonsin tidigare. Plötsligt kan individer och hela organisationer ansluta till människor på en verkligt global skala, oavsett vilket språk de talar.

Bemyndigande av författare och globala läsare

Förlagsbranschen är en av de mest spännande ställena att se NMT i aktion. För en oberoende författare var drömmen om att nå läsare runt om i världen en massiv huvudvärk. Det betydde att hitta (och finansiera) dyra mänskliga översättare och navigera genom en labyrint av internationella distributionsavtal.

NMT har helt vänt på det skriptet. En författare kan nu ta sitt färdiga manuskript och få det översatt till flera språk med otrolig hastighet och imponerande noggrannhet. Det betyder att de kan självpublicera på internationella marknader, hitta nya läsare och bygga en global fanbase utan att behöva en stor förlag för att öppna grinden.

För författare och bokälskare som använder specialiserade tjänster betyder detta att en hel EPUB-fil kan översättas till dussintals språk med bara ett klick. Systemet behåller författarens röst, originalformateringen och till och med de stilistiska särdragen intakta. Det är inte bara en liten bekvämlighet; det är en djupgående förändring i hur berättelser delas och njuts över hela världen.

NMT ger författare en direkt linje till läsare över hela världen. Det handlar inte bara om att ändra ord från ett språk till ett annat; det handlar om att bevara historiens själ och skaparens unika röst.

Det är också en spelväxlare för studenter och forskare. Tänk på det: tillgång till akademiska artiklar, historiska dokument och viktig utländsk litteratur brukade helt bero på dina språkkunskaper. Nu kan NMT översätta tätt, teknisk material nästan omedelbar, vilket gör kunskap mer universell och påskyndar global forskning och samarbete. För att se hur det fungerar bakom kulisserna kan du vilja läsa vår artikel om https://booktranslator.ai/blog/how-ai-translates-books-into-99-languages.

Omvandling av affärskommunikation

Bortom bokhyllan är NMT en kraftfull motor för global affärer. Företag kan nu prata med sina internationella kunder mycket mer effektivt, bygga starkare anslutningar och växa sin räckvidd på nya marknader.

Här är några viktiga sätt som NMT gör en stor skillnad:

- Webbplats- och innehållslokalisering: Ett företag kan översätta sin hela webbplats, blogg och marknadsföringsmaterial på en bråkdel av den tid det brukade ta. Det hjälper dem att skapa en verkligt lokal känsla för användare i olika länder, vilket är absolut kritisk för att bygga förtroende och göra försäljning. En e-handelsbutik byggd för en engelsktalande publik kan bli en helt funktionell spansk eller japansk butik nästan över en natt.

- Realtidschatstöd: NMT är magin bakom flerspråkiga chatbots och direktöversättning. Det låter supportagenter hjälpa kunder på deras modersmål, vilket gör för en mycket bättre upplevelse. Människor kan få sina problem lösta utan att behöva stamma genom ett språk de inte kan väl.

- Intern företagskommunikation: För stora multinationella företag överbryggar NMT kommunikationsgapet mellan deras globala lag. Viktiga memorandum, utbildningsdokument och företagsomfattande meddelanden kan översättas på flykt, vilket säkerställer att varje enskild anställd är på samma sida, oavsett var de är eller vilket språk de talar.

Och det handlar inte bara om att översätta dokument längre. NMT är tekniken som möjliggör saker som realtidsöversättning i Google-möten, vilket omedelbar slår ner språkbarriärer medan människor samarbetar live. Dessa vardagliga användningar visar att NMT inte bara är en akademisk nyfikenhet—det är ett praktiskt verktyg som formar hur vi alla interagerar och gör affärer.

Förståelse av styrkor och begränsningar för NMT

Neuralmaskintranslation har gjort ett enormt språng i kvalitet, men som all teknik är det inte magi. För att använda den väl—oavsett om det är för en roman eller en webbplats—behöver du en klar syn på vad det gör briljant och var det fortfarande snubblar.

Den största vinsten för NMT är dess grepp om sammanhang. Gamla system fungerade ord-för-ord, som en klumpig fickordbok. NMT, å andra sidan, tittar på hela meningar eller till och med stycken för att räkna ut den avsedda betydelsen. Det här är hur det kan säga vilken "bank" du menar (flod eller finansiell) och reda ut komplex grammatik, producera översättningar som känns flytande och naturliga.

De tydliga fördelarna med modern NMT

Denna förmåga att se den större bilden ger några allvarliga fördelar, vilket är varför NMT har blivit så väsentligt för alla som arbetar över språk.

- Exceptionell flytande och läsbarhet: NMT-modeller tränas på berg av mänskligt skriven text, så de blir mycket bra på att efterlikna vår kadans och flöde. Resultatet är en översättning som bara läser bättre.

- Hantering av komplex grammatik: Det kan helt ordna om en mening för att passa reglerna för målspråket, ett enormt hinder för äldre metoder som ofta producerade rörig, meningslös utgång.

- Konstant förbättring: NMT-systemen lär sig alltid. Mata dem med mer högkvalitativ data, och de blir smartare, förfining av deras noggrannhet och plockar upp mer nyans över tid.

Denna inlärningsförmåga har lett till något fantastisk framgång. Tillbaka 2020, till exempel, avslöjade Facebook en modell som kunde översätta direkt mellan 100 olika språk, hoppar över det vanliga steget att gå genom engelska först. Det lärde sig till och med att översätta mellan språkpar som det aldrig hade tränat explicit på. Du kan få en djupare känsla av dessa framsteg genom att utforska historien om dessa översättningsmilepälar på Wikipedia.

Navigera de nuvarande begränsningarna

Så imponerande som NMT är måste du känna till dess gränser. Det här är inte avtalsbrytare, bara realiteter att planera för. En av de största problemen är att NMT-modeller kan plocka upp och till och med förstärka fördomar från sin träningsdata. Om källtexten innehåller stereotyper kommer översättningen sannolikt att bära dem över.

Ett annat knepigt område är mycket kreativt eller subtilt språk.

Även om NMT kan översätta en affärsrapport med hög noggrannhet, kämpar det ofta med ordlekar, det skiktade humorn i en roman eller de specifika kulturella referenser som ger texten dess unika smak.

AI förstår inte riktigt kultur eller kreativ avsikt; det är bara en mästare på statistik, förutsäga den mest sannolika sekvensen av ord. Det kan också leda till det som kallas "hallucinationer," där modellen genererar text som låter perfekt men är faktiskt fel eller helt påhittad.

Slutligen kan NMT ha problem med mycket långa dokument. En hel roman, till exempel, är ofta för mycket för det att hantera på en gång på grund av det som kallas ett "kontextfönster"—mängden text det kan bearbeta på en gång. Vi skrev en hel guide som förklarar hur kontextfönsterdilemmat påverkar AI-bokbersättning.

För alla projekt där noggrannhet och nyans är överordnad är det smartaste tillvägagångssättet att använda NMT som en fantastisk utgångspunkt, sedan ha en mänsklig expert granska och förfina den. Den kombinationen av maskinell hastighet och mänsklig förstånd är där den verkliga magin händer.

Sätt NMT i arbete på dina egna projekt

Nu när du har ett solidt grepp om vad neuralmaskintranslation är, låt oss bli praktiska. Hur kan du sätta det i arbete på dina egna projekt? Oavsett om du är en författare som försöker nå en global publik eller en förläggare som vill utöka din katalog, handlar det om att använda NMT effektivt om några kärnprinciper.

Det börjar allt med din källtext. NMT-modeller är otroligt sofistikerade, men de är inte tankeläsare. De trivs på tydligt, entydig språk. Ju renare och mer rakt fram din originaldokument är, desto bättre blir din översättning.

Tänk på det som att ge AI de bästa möjliga ingredienserna. Att ta lite tid för att förenkla komplexa meningar och ta bort tvetydig formulering kan dramatiskt minska fel och få den slutliga översättningen att kännas mycket mer naturlig.